Ledys Izquierdo, Andrés Rico, Eduardo Pinto. Miembros de AIpocrates.

Línea de educación en inteligencia artificial

¿Está el humano delegando el arte de pensar?

En la actual arquitectura de la medicina y las ciencias, el poder ya no reside en el acervo cognitivo estático, sino en la capacidad intelectual de formular la pregunta correcta. Nos hallamos ante una encrucijada ontológica: la inteligencia artificial generativa ha abierto una puerta seductora hacia la delegación de nuestras funciones intelectuales más nobles a un sistema de procesamiento estadístico. El riesgo no es solo técnico, sino existencial; corremos el peligro de mutar de pilotos expertos a pasajeros pasivos, entregando nuestra soberanía intelectual a una tecnología que apenas comenzamos a comprender.

Esta delegación fomenta lo que hoy denominamos como «vibe knowledge» (conocimiento por sensaciones/intuición), un estado donde la información generada por la IA se siente correcta y coherente, pero carece de sustancia, rigor o supervisión humana. Cuando el humano es removido de la ecuación de la verdad, el conocimiento se vuelve una cáscara vacía. El dilema es crudo, ¿nos está haciendo la IA más inteligentes o simplemente está subvencionando nuestra pereza cognitiva?

La respuesta no es el ludismo, sino el ascenso hacia un uso reflexivo de la herramienta. Debemos reclamar el mando, transformando la IA de una enciclopedia pasiva en un andamiaje cognitivo que potencie, y no sustituya, nuestra capacidad de juicio.

Del desuso a la atrofia

La pedagogía contemporánea identifica tres pilares en la automatización del pensamiento: el Deskilling (pérdida de habilidades previas) y el Mis-skilling (aprendizaje de sesgos). Sin embargo, el más insidioso es el Never-skilling. Este concepto define una verdadera atrofia del aprendizaje: la incapacidad de llegar a dominar la base de una disciplina como la fisiopatología en medicina porque la herramienta ofrece la solución antes de que el usuario haya realizado el esfuerzo de construir el problema.

Si el estudiante se salta el proceso de razonamiento clínico porque un algoritmo entregó el diagnóstico y el tratamiento aún caso o problema clínico, nunca desarrollará las conexiones neuronales necesarias para el ejercicio profesional autónomo. Estamos creando una generación de profesionales que conocen la respuesta, pero son incapaces de reconstruir el camino que lleva a ella.

¿Los LLM nos harán humanos menos inteligentes o más perezosos?

Esta interrogante nos confronta con la economía cognitiva, una tendencia biológica hacia la ley del mínimo esfuerzo energético y por ende intelectual que, sin una voluntad socrática, nos conduce inevitablemente hacia la irrelevancia profesional.

De un Prompt Perezoso a un Tutor Provocador

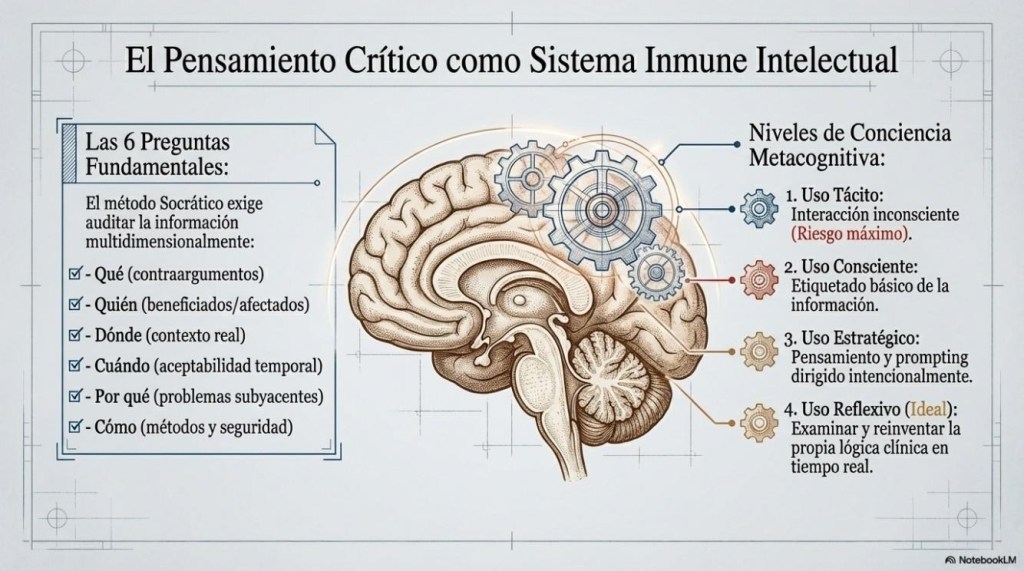

La distancia entre el usuario mediocre y el estudiante líder se mide en la calidad de su interacción con la máquina. Para alcanzar un uso reflexivo el nivel más alto de la metacognición, por encima del uso táctico, consciente o estratégico, debemos abandonar el Prompt Perezoso.

- El Prompt Perezoso (Bad Prompt), la definición de “un prompt perezoso”, implica la búsqueda de la solución, sin que se procure la integración, ni contextualización, es decir solo la solución sin esfuerzo cognocitivo. ejemplo: ¿Cuál es el tratamiento para la neumonía en un niño de 5 años?

- Resultado: Una respuesta automática, una receta estandarizada, la facilidad de la respuesta implica un esfuerzo cognitivo y un aprendizaje nulo, el camino directo al Never-skilling.

- El Prompt Socrático (Leader Prompt): Aquí la IA asume el rol de un tutor provocador. El usuario no pide la solución, sino que propone su lógica para ser desafiada. Ejemplo: «Voy a proponerte un plan de manejo para una neumonía pediátrica. Tu rol es ser un consultor socrático: cuestiona cada uno de mis pasos basándote en la evidencia actual y señálame los posibles errores en mi lógica de dosificación».

- Resultado: Construcción de conocimiento, defensa de la tesis y un fortalecimiento del juicio clínico. La IA ya no piensa por nosotros, sino con nosotros.

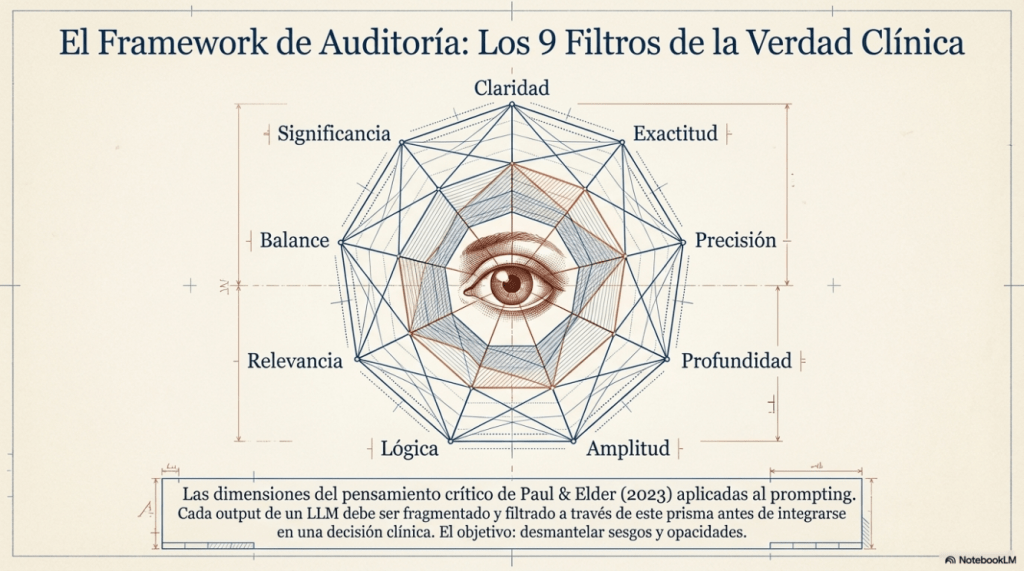

El Sistema Inmune Intelectual: Los 9 Filtros de la Verdad

Para blindarnos contra el vibe knowledge, las alucinaciones algorítmicas, los sesgos propios del modelo provenientes de los datos de pre-entrenamiento, el aprendizaje por refuerzo (“sycophancy”) y los sesgos propios del humano (confirmación, automatización, etc.) cada interacción debe ser auditada mediante las dimensiones del pensamiento crítico de Paul & Elder. Estos filtros constituyen nuestro sistema inmune intelectual:

- Claridad: Evita la erosión de capacidades por asimilar jerga sin comprensión real.

- Acción: Pedir definiciones desde la fisiopatología.

- Ejemplo: Define claramente qué entiendes por choque cardiogénico antes de analizar este caso clínico.

- Exactitud: Combate el Mis-skilling y las alucinaciones.

- Acción: Exigir fuentes de evidencia (EBM) recientes.

- Ejemplo: ¿Qué guías (EBM) respaldan esta recomendación? Indica si hay contradicciones con la guía AHA 2024.

- Precisión: Mitiga el riesgo de decisiones críticas basadas en ambigüedades.

- Acción: Solicitar dosis y valores específicos.

- Ejemplo: Proporciona las dosis exactas según la función renal del paciente (CrCl 30 ml/min).

- Relevancia: Evita la sobrecarga cognitiva filtrando el ruido estadístico.

- Acción: Instruir a la IA para priorizar lo urgente.

- Ejemplo: Ignora antecedentes no relacionados y enfócate solo en los síntomas que determinan la urgencia actual.

- Profundidad: Combate frontalmente el Never-skilling.

- Acción: Obligar a explicar el «por qué» bioquímico o mecánico.

- Ejemplo: Explica el mecanismo fisiopatológico detallado por el cual este marcador de laboratorio se eleva.

- Amplitud: Evita la visión de túnel y la omisión de determinantes sociales.

- Acción: Exigir escenarios alternativos y contextos culturales.

- Ejemplo: Analiza tres diagnósticos diferenciales y considera cómo influye el entorno rural en la adherencia.

- Lógica: Desmantela la caja negra algorítmica.

- Acción: Evaluar la cadena de pensamiento (Chain-of-Thought).

- Ejemplo: Analiza los síntomas y explica tu razonamiento paso a paso antes de sugerir un diagnóstico.

- Significancia: Humaniza la atención frente a la estadística fría.

- Acción: Priorizar el impacto vital y el relato humano.

- Ejemplo: Identifica los tres factores de mayor impacto en el pronóstico vital y el bienestar de este paciente.

- Balance: Detecta sesgos comerciales o raciales secuestrados por la industria.

- Acción: Investigar imparcialidad y sesgos algorítmicos.

- Ejemplo: ¿Existe algún sesgo algorítmico conocido que favorezca este diagnóstico en esta población?

La complejidad de la vida real nos obliga a elegir modos de interacción según el escenario:

- Modo Centauro: El humano ejerce una supervisión crítica sobre tareas estandarizadas donde la IA tiene cierta autonomía. Es una división de trabajo clara.

- Modo Cíborg: En casos de alta complejidad, la narrativa humana y el dato algorítmico se entrelazan indisolublemente. Aquí, el juicio clínico dirige la potencia de cálculo para dar sentido a lo que el dato puro no puede explicar.

La Regla de Oro del Estudiante Líder

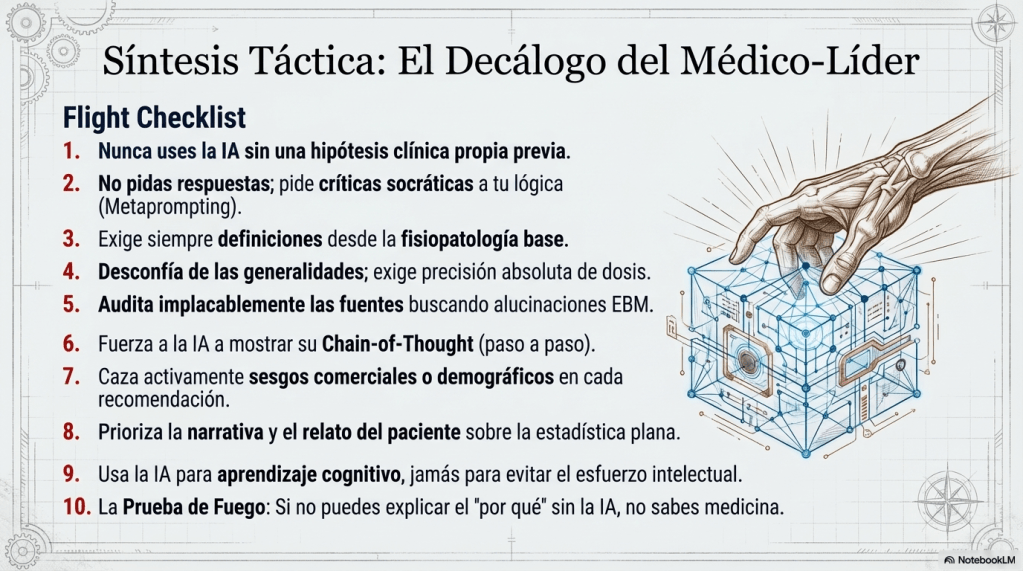

El liderazgo en la era de los algoritmos no es un dominio técnico, sino un ejercicio de carácter que requiere humildad y curiosidad. Para mantener el mando, el Decálogo del Estudiante Líder establece principios innegociables:

- Hipótesis previa: Nunca uses la IA sin una hipótesis propia ya formulada.

- Cuestionamiento lógico: No pidas respuestas; pide críticas feroces a tu propia lógica.

- Prioridad narrativa: Antepón siempre el relato humano del paciente sobre la estadística del dataset.

- La Regla de Oro de Roosevelt: «La tecnología es un esclavo útil, pero un amo peligroso».

El clímax de esta soberanía se resume en un mandato profesional, si no puedes explicar el «por qué» de una decisión médica sin mencionar a la IA, has dejado de saber medicina; has perdido el liderazgo.

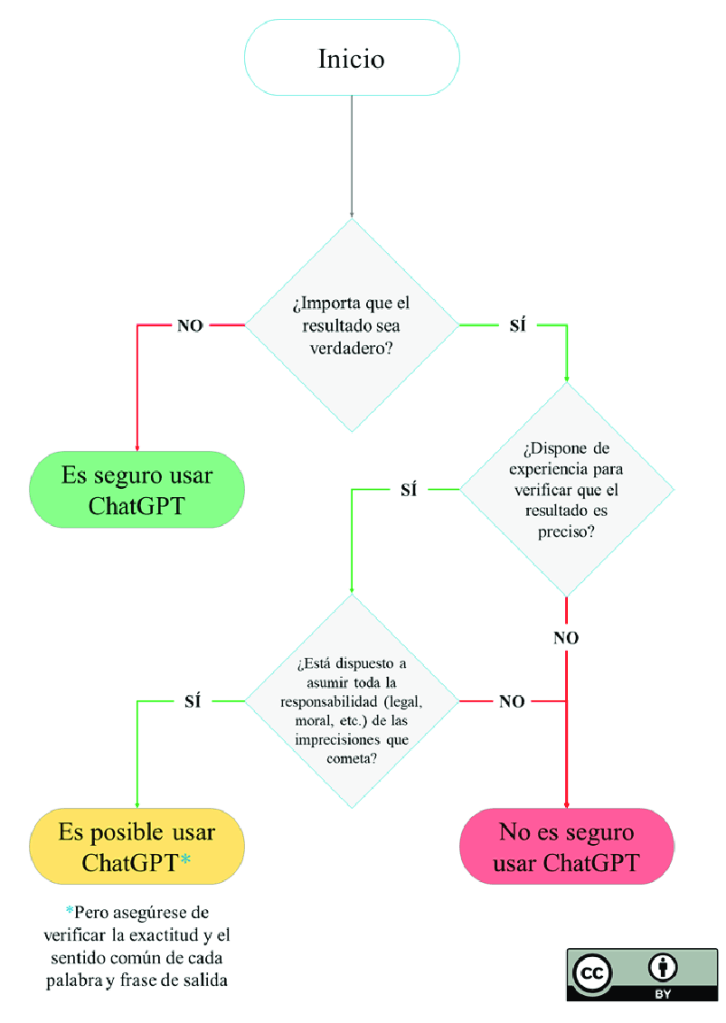

Diagrama de flujo para el uso seguro de ChatGPT. Fuente: Sabzalieva y Valentini (2023; diseño de Aleksandr Tiulkanov; rediseño de Fraidy Alonso Alzate Pamplona; bajo licencia de Atribución CC BY; fuente: Al and Data Policy Lawyer).

Conclusión: Hacia una Medicina Algorítmicamente Humana

La progresión de competencias de la UNESCO nos insta a evolucionar de solos consumidores que comprenden y aplican a creadores que auditan y diseñan sistemas donde la técnica científica se funde con la compasión ética.

La Medicina Algorítmicamente Humana (MAH) no es una práctica dictada por máquinas, sino una medicina híbrida donde las capacidades humanas son potenciadas por el cálculo, pero siempre bajo la responsabilidad final de un individuo soberano. Saber preguntar es el pilar de nuestra autonomía.

Antes de su próxima interacción con un LLM, deténgase y audite su intención: ¿Está utilizando esta herramienta para expandir su arquitectura mental o para permitir que su pensamiento se atrofie en la comodidad del silencio algorítmico?

Referencias

Brazao P and Tinoca L (2025) Artificial intelligence and critical thinking: a case study with educational chatbots. Front. Educ. 10:1630493. doi: 10.3389/feduc.2025.1630493

Rossella Suriano, Alessio Plebe, Alessandro Acciai, Rosa Angela Fabio. (2025)Student interaction with ChatGPT can promote complex critical thinking skills. Learning and Instruction, Volume 95. https://doi.org/10.1016/j.learninstruc.2024.102011.

Wang, Xiaofei et al. (2026). Reasoning-driven large language models in medicine: opportunities, challenges, and the road ahead. The Lancet Digital Health. January 30, 2026. DOI: 10.1016/j.landig.2025.100931

Ioannidis, John P.A. (2016). Evidence-based medicine has been hijacked: a report to David Sackett. Journal of Clinical Epidemiology, Volume 73, 82 – 86. DOI: 10.1016/j.jclinepi.2016.02.012

Ho, YR., Chen, BY. & Li, CM. (2023). Thinking more wisely: using the Socratic method to develop critical thinking skills amongst healthcare students. BMC Med Educ 23, 173. https://doi.org/10.1186/s12909-023-04134-2

Sabzalieva y Valentini (2023). diseño de Aleksandr Tiulkanov; rediseño de Fraidy Alonso Alzate Pamplona; bajo licencia de Atribución CC BY; fuente: Al and Data Policy Lawyer.