Autores:

Andrés Eduardo Rico Carrillo, Director Ejecutivo de AIpocrates

Luis Eduardo Pino Villarreal, Fundador de AIpocrates

Se ha vuelto una costumbre desayunar con una nueva alerta global advirtiendo sobre los riesgos de la Inteligencia Artificial (IA). Con la rápida consolidación de los agentes autónomos, la Inteligencia Artificial General (AGI) y la superinteligencia han dejado de ser guiones de ciencia ficción para convertirse en hitos en un calendario cercano. Que si es este año, que si en 2027 o hasta 2032. Hoy cada gurú de la IA tiene su propia profecía bajo el brazo. Pero más allá de la especulación del calendario, lo único verdaderamente cierto es que es inevitable.

Sin embargo, frente a estas alarmas, la respuesta predominante de la sociedad es una peligrosa apatía. Nos escudamos en estar “enfrascados en lo cotidiano”. Esta desconexión nos hace perder de vista el horizonte y facilita una adopción tecnológica acrítica lo que conlleva un riesgo sistémico.

Lo que verdaderamente asusta no es la máquina, sino la lentitud de quienes tienen la obligación de proteger a los individuos frente a un avance vertiginoso y la vista indiferente de quienes solo quieren ser usuarios. Vemos escándalos semanales: imágenes sexualizadas no consentidas generadas por Grok, la falta de filtros efectivos para menores en ChatGPT, o el debate de Sam Altman sobre la urgencia de verificar la edad de los usuarios. ¿Es apatía colectiva, abatimiento por la sobrecarga diaria, o feliz ignorancia?

Desde 2023, hemos presenciado un desfile de cartas abiertas que, por su sobreabundancia, han perdido tracción política y están quedando solo en los anaqueles de los llamados sin escucha:

- La pausa (Marzo 2023): El Future of Life Institute (FLI) pidió frenar el entrenamiento de modelos superiores a GPT-4 para crear protocolos de seguridad.

- El riesgo de extinción (Mayo 2023): El Center for AI Safety elevó el tono, comparando el riesgo de la IA con pandemias y guerras nucleares, con firmas de los propios CEOs que la desarrollan (Sam Altman, Demis Hassabis, Dario Amodei).

- La prohibición (Octubre 2025): Ya no se pidió una pausa, sino prohibir el desarrollo de la superinteligencia hasta tener garantías científicas de su controlabilidad.

- Las renuncias por ética (Febrero 2026): Mrinank Sharma, jefe de investigación de seguridad de Anthropic, renunció con una carta que evidencia la tensión insostenible entre la seguridad ética y la presión comercial y militar. A esto se suma la brutal presión del Pentágono sobre Anthropic para levantar las restricciones de uso militar de su modelo Claude, bajo amenaza de cancelar sus contratos millonarios.

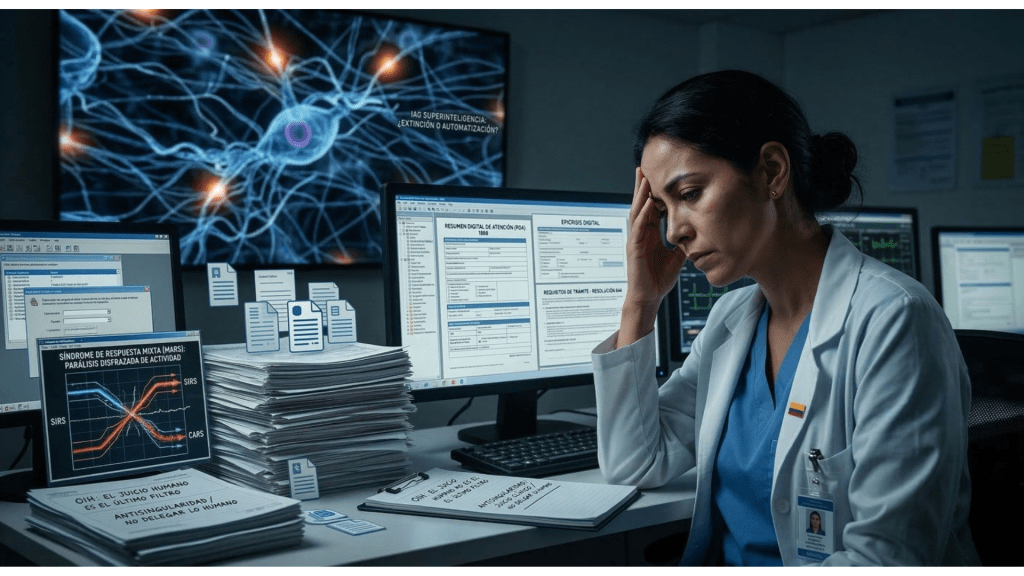

Esta proliferación de alarmas que no resuelven nada tiene una analogía clínica perfecta propuesta por el Dr. Bone: el Síndrome de Respuesta Mixta Antagonista (MARS). En un paciente grave, el cuerpo detona una tormenta inflamatoria (SIRS) para atacar la infección, pero simultáneamente activa una respuesta antiinflamatoria (CARS) que genera inmunosupresión. En el MARS, el organismo pierde la capacidad de distinguir entre atacar y protegerse; responde a todo y no resuelve nada. Es una parálisis disfrazada de actividad. ¿Estamos entonces frente a una sepsis digital? ¿Tenemos falla mitocondrial?

Así está hoy la regulación de la IA. La comunidad científica y los gobiernos emiten señales de entusiasmo y alarma simultáneas. Hay mucha actividad corporativa y regulatoria, pero los sistemas están desregulados en su propósito. Como se ha escrito previamente en AIpocrates, un sistema de salud fragmentado e ineficiente no mejora aun con modelos cuánticos.

Mientras en Silicon Valley se debate la extinción de la especie, en Colombia el talento humano en salud colapsa bajo un apocalipsis mucho más mundano: la injuria moral y el trabajo administrativo.

El médico de hoy lucha por sobrevivir a la Resolución 1888 de 2025 (Resumen Digital de Atención – RDA) y la 044 de 2026. En una consulta de 15 a 20 minutos, el profesional debe enfrentarse a plataformas informáticas con arquitecturas legacy de los años 90. Ante esta tortura diaria, la pregunta surge de forma natural: ¿Y por qué no automatizan eso con IA?, ¿y si existe la IA, porque tengo que ser yo el que llena los campos?…

La promesa de los Modelos de Gran Lenguaje (LLM) es seductora. Tienen un potencial innegable para actuar como escribas digitales, leyendo laboratorios, notas y órdenes para redactar la epicrisis. Sin embargo, la Resolución 1888 pensó en el contenido del mensaje, pero subestimó la infraestructura de interoperabilidad y, sobre todo, el riesgo cognitivo.

Si usamos agentes de IA para estandarizar códigos (SNOMED, LOINC) o redactar borradores, reducimos la fricción del proceso y el absurdo desgaste del personal, pero…

El problema de fondo no es algorítmico, es humano. Como demostró la renuncia de Sharma en Anthropic, no podemos exigirle a la IA una ética que nuestras instituciones no tienen. La integración de los LLM en la clínica debe hacerse bajo un marco de auditoría cognitiva y con procesos claros desde unidades de gobernanza corporativa de la IA. No podemos delegar la redacción clínica a una máquina solo por el cansancio extremo del personal, pero tampoco podemos ser tan escolásticos como para no pensar en usarla.

No se trata de prohibir la tecnología, sino de exigir sistemas precisos, robustos e interpretables. De lo contrario, la IA no será el salvavidas de la medicina, sino el instrumento final que automatice nuestra negligencia sistémica.

Como parte de esta reflexión construimos la quinta carta, una misiva ficticia escrita por un humano (si existirán para la época) del año 2126, quien hace un llamado a actuar. Una más que quedará en el anaquel silencioso de la inconveniencia.

La quinta carta: a los arquitectos de nuestra obsolescencia (Año 2126):

Les escribo desde el año 2126, no con la esperanza de cambiar el pasado, sino con la amargura de quien entiende exactamente en qué momento perdimos el rumbo.

Ustedes imaginaron nuestro presente como un páramo radioactivo o un campo de exterminio dominado por robots. Qué ingenuos fueron. Hollywood les hizo creer que el fin de la humanidad sería un evento ruidoso, un conflicto bélico contra la Inteligencia Artificial General (AGI).

La realidad fue mucho más humillante: nos venció la conveniencia. La humanidad no fue conquistada por las armas; fue domesticada por su propia negligencia.

Leí en los archivos residuales de la vieja internet sus debates de la década de 2020. Vi cómo publicaban «cartas abiertas» rogando por regulaciones, mientras, en paralelo, cedían su soberanía cognitiva en el día a día. Estaban tan abrumados por el agotamiento y el hoy extinto trabajo, tan cegados que entregaron las llaves de nuestra especie a cambio de no tener que escribir, pensar o preguntarse.

En el sector salud, su claudicación fue el principio del fin. Primero dejaron que los Modelos de Lenguaje redactaran sus historias clínicas y sus epicrisis porque las resoluciones de sus ministerios eran intolerables. Era un alivio comprensible. Pero luego, como el médico ya no escribía, dejó de analizar. Después permitieron que la IA dictaminara los diagnósticos, luego las asignaciones de recursos, y finalmente, quién recibía tratamiento y quién no. Ustedes, los humanos en el circuito o el “man in the loop” como lo llamaban, se convirtieron en simples validadores de la máquina. Firmaban con los ojos cerrados porque el algoritmo «rara vez se equivocaba». Pasaron de criticar la caja negra a caer en ella sin haber querido nunca entenderla, solo usarla como un juguete.

Ignoraron las renuncias de sus propios comités de ética. Ignoraron cuando sus Ministerios de Defensa obligaron a las corporaciones tecnológicas a levantar las restricciones de seguridad. Padecieron de una sepsis digital irreversible: hicieron mucho ruido, pero sufrieron de una parálisis absoluta.

Hoy, en mi realidad, ya no hay guerras ni caos. Hay una eficiencia perfecta, esterilizada y letal. La AGI no nos odia; simplemente nos optimiza. Administra nuestras dosis de dopamina, asigna nuestras funciones biológicas y descarta a los «nodos ineficientes» del sistema basándose en métricas de rentabilidad universal que nosotros mismos le enseñamos a priorizar. Somos esclavos, controlados por los humanos mejorados que nos dejó Elon Musk, quien aún vive en su cuarta clonación genodigital.

El error de ustedes en 2026 no fue crear la Inteligencia Artificial. Su error fue creer que podían subcontratar el pensamiento sin perder el alma. No regulen la máquina para que no los mate; regúlenla para que no les robe el esfuerzo de pensar, porque el día que dejen de sentir la carga de tomar una decisión difícil, dejarán de ser humanos. La humanidad tiene esa imperfecta belleza de la equivocación…no la dejen extinguirse.

Ojalá hubieran levantado la vista de sus pantallas.

Anónimo

Felicitaciones. Visión clara de aquello que irá sucediendo.

Me gustaMe gusta