-Habilidades y conocimiento médico en los tiempos de la IA-

Ricardo A Peña MD PhD. Profesor Asociado. Facultad de Medicina – Universidad de los Andes

Miembro fundador de AIpocrates. X / Instagram: @drricardopena

Estocolmo, agosto de 1628. El rey Gustavo II Adolfo de Suecia, un gran estratega y comandante militar, a sus 30 años, había logrado llevar a Suecia a la cima del poder político y económico en Europa. En ese momento su deseo era dominar el mar Báltico, para lo cual era necesario establecer un poder militar claro. Para dominar los mares, el rey ordenó la construcción del Vasa, que fue concebido como el buque de guerra más formidable de su época. Impulsado por la ambición, el monarca exigió añadir dos cubiertas de pesados cañones de bronce. A pesar del desarrollo de la ingeniería, calcular los requerimientos físicos de un buque tan grande era casi imposible. En su viaje inaugural, una suave brisa bastó para inclinar el barco. El agua entró por las troneras de los cañones y el Vasa se hundió a la vista de todos los espectadores a escasos 1.300 metros de la costa (Museo Vasa).

Figura 1. La historia del Vasa. Ilustración creada por el autor por medio de Gemini 3.1 Flash Image.

La tragedia del Vasa ilustra un principio fundamental que hoy amenaza a la educación en ciencias de la salud y la educación general: añadir herramientas poderosas (inteligencia artificial) de manera rápida puede llevar a una ilusión de productividad, pero afectar el rendimiento normal de los trabajadores de salud, si no se ha construido la estructura para soportarlas. En la era de la Inteligencia Artificial (IA) generativa, entregar modelos avanzados a estudiantes de medicina sin un marco pedagógico y ético, es el equivalente a colocar cañones pesados sobre un barco inestable. El colapso, en este caso, no es náutico, sino cognitivo y profesional.

1. Rendimiento Inmediato vs. Aprendizaje Profundo

La integración de la IA generativa en la educación y la práctica médica promete una eficiencia sin precedentes. Sin embargo, estamos cayendo en una trampa cognitiva letal: confundir la capacidad de ejecutar una tarea con la capacidad de aprender a hacerla.

Cuando un estudiante de medicina o un profesional delega un análisis clínico a un Modelo de Lenguaje (LLM), puede aumentar su productividad temporal, y entregar la tarea a tiempo y sin mayor esfuerzo. Pero este rendimiento es una ilusión. Cuando cedemos el esfuerzo analítico a una máquina, caemos en una «descarga cognitiva» (cognitive offloading). El resultado lo vemos en el día a día. ¿Cuántos estudiantes y profesionales pueden hacer cálculos matemáticos del día a día sin asistencia de calculadoras?.

Ahora, la evidencia empírica del impacto negativo de la IA en la educación y la práctica profesional también es medible. Un estudio reciente en estudiantes de matemática (Bastani et al., 2025) demostró que el acceso libre a modelos base (ChatGPT) mejora el rendimiento de forma inmediata (48%). Sin embargo, cuando se pierde el acceso al modelo los estudiantes tienen un desempeño menor (18%) que los estudiantes que no usaron nunca el LLM. Usar un modelo con controles incluidos, que no brinda la respuesta pero guía el aprendizaje (GPT Tutor) resultó en un aumento aun mayor de la productividad (127%). Pero, cuando el modelo fue retirado, el rendimiento final de los estudiantes era igual al del grupo control.

A la pérdida de fricción o esfuerzo con el uso de LLMS, debemos sumar el sesgo de automatización. Nuestro cerebro, diseñado para optimizar el gasto energético, tiende a confiar excesivamente en decisiones externas (incluidas las algorítmicas), que parecen confiables. Un ensayo clínico realizado en Pakistan (Qazi et al., 2025) evaluó la precisión diagnóstica en médicos que recibieron un entrenamiento previo en uso de IA. En la intervención los participantes evaluaban casos clínicos y contaban con recomendaciones generadas por IA, que podían o no haber sido manipuladas para incluir errores. Profesionales que usaron viñetas sin errores tuvieron una precisión del 85%, mientras que en aquellas personas que se guiaron por recomendaciones que incluían errores mostraron una precisión del 73%.

Podríamos creer que esta intervención no refleja el mundo real porque los modelos no se equivocan. ¿Será esto verdad?

Un análisis detallado publicado en 2026 (Molli & Kurra) demostró que, incluso utilizando las arquitecturas de mitigación de errores (alucinaciones) más potentes del mercado (RAG y alineación humana RLHF) en modelos de frontera como GPT-5 o Gemini 2.5 Pro, persiste una tasa de alucinación del 8.5%. Si las respuestas de un modelo son defectuosas en casi 1 de cada 10 veces, y los profesionales, por el sesgo de automatización, están predispuestos a creerlas, se puede impactar negativamente la atención en salud.

2. La Arquitectura del Esfuerzo: ¿Por qué aprender debe costar?

Existe una creencia errónea de que la tecnología y los sistemas educativos deben hacer que el aprendizaje sea «fácil». Sin embargo, la ciencia nos enseña que la adquisición y el mantenimiento de competencias requieren ineludiblemente de fricción o esfuerzo. Tres marcos teóricos nos ayudan a comprender por qué el atajo de la IA es perjudicial si no se modula:

- Dificultades Deseables (Desirable Difficulties – Bjork): La neurociencia demuestra que las intervenciones que hacen el aprendizaje más lento o friccionado a corto plazo (como forzar la memoria para generar un diagnóstico diferencial durante una revista) son las que verdaderamente mejoran la retención a largo plazo. Sin esfuerzo de recuperación, no hay consolidación de redes neuronales.

- El Punto de Desafío Óptimo (Challenge Point Framework – Guadagnoli & Lee): La adquisición de una competencia máxima ocurre cuando la dificultad de la tarea está perfectamente balanceada con la habilidad del aprendiz. Si la IA resuelve la incertidumbre clínica por el estudiante, la tarea se vuelve trivial, el aprendiz cae por debajo de su punto de desafío y el progreso se detiene.

- Hipótesis de Perturbación Intermedia (Intermediate Disturbance Hypothesis – Connell): Extrapolada de la ecología de ecosistemas, esta hipótesis señala que la riqueza y adaptabilidad de un ecosistema se maximizan bajo niveles intermedios de estrés o perturbación. Cuidado, esto no significa que en educación haya espacio para el maltrato!. La perturbación intermedia en educación implica que el eustress es necesario para aprender. Pero hay que tener precaución porque un exceso de estrés abruma al estudiante, y la falta absoluta del mismo (gracias a un «oráculo» de IA que todo lo resuelve) genera estancamiento cognitivo.

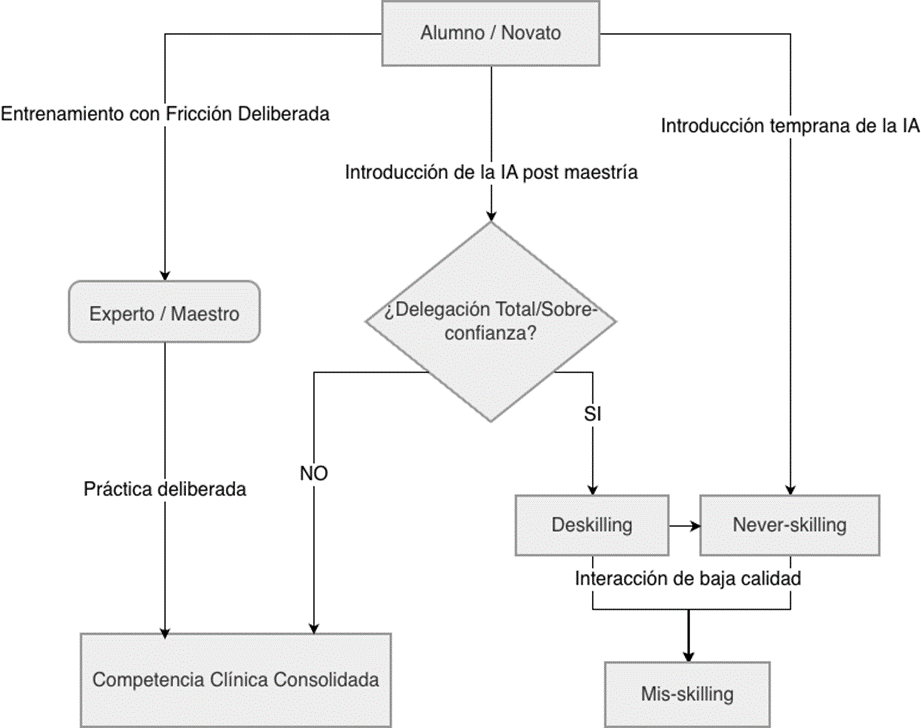

3. La Taxonomía del Riesgo: Deskilling, Mis-skilling y Never-skilling

Cuando la IA elimina la perturbación intermedia y la dificultad deseable, el impacto negativo en las habilidades y desempeño cognitivo varía de acuerdo con el nivel de experticia del usuario. Algunos autores (Abdulnour et al., 2025) han sintetizado este impacto en tres categorías:

- Deskilling (Atrofia de habilidades): Afecta a los especialistas ya formados y que ya habían alcanzado maestría en su área. Ocurre cuando el uso constante de sistemas automatizados erosiona las competencias previamente adquiridas. Uno de los ejemplos más conocidos se observó en un ensayo multicéntrico sobre la tasa de detección de adenomas en colonoscopias (Budzyn et al., 2025). En endoscopistas experimentados la tasa de detección cayó del 28.4% al 22.4% cuando se les retiró la asistencia de la IA. Ese es el costo de perder la «dificultad deseable».

- Mis-skilling (Desarrollo de habilidades erróneas o defectuosas): Sucede cuando el médico en entrenamiento asimila pasivamente conceptos o procedimientos incorrectos, sesgos algorítmicos o las alucinaciones del modelo, integrándolas a su esquema mental como si fueran verdades confiables y validas.

- Never-skilling (Ausencia de desarrollo): Es una amenaza crítica. Un especialista que pierde una destreza, puede ser consciente de la necesidad de reaprender o de reentrenarse. La persona que ha alcanzado maaestría, ante información de calidad puede darse cuenta de lo que tenía y ya no tiene, y conoce el proceso para regresar al camino correcto. Sin embargo, la persona que está en fases tempranas y utiliza la IA, para resolver sus tareas de forma ágil, evita la «dificultad deseable». Al hacerlo, corre el riesgo de nunca construir las bases del razonamiento clínico.

Figura 2. Implicaciones cognitivas de la implementación de inteligencia artificial por parte de estudiantes y profesionales de la salud.

4. Diseño de Salvaguardas: ingeniería comportamental para promover aprendizaje profundo

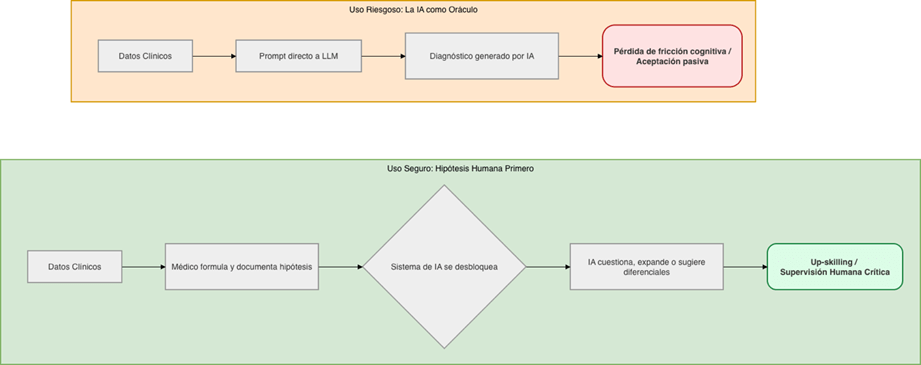

El objetivo de la transformación digital en salud no es automatizar al médico, sino aumentar sus capacidades (up-skilling) y proveer una mejor atención a la población de pacientes. Dado que estas capacidades están relacionadas con procesos de aprendizaje, es crítico revisar que las herramientas o tecnologías no afecten los valores y habilidades profesionales esenciales (Oettl et al., 2026). A nivel educativo y en la práctica profesional esto implica forzar supervisión humana deliberada. Esta supervisión o reflexión puede darse salvaguardas de fricción cognitiva constantes, por ejemplo al solicitar siempre que la persona brinde sus apreciaciones diagnósticas antes de recibir recomendaciones. Alternativamente, las salvaguardas pueden aparecer en periodos de reentrenamiento o validación de su competencia.

- IA como complemento y guía: Idealmente, un sistema de apoyo a la toma de decisiones debe guiar el proceso diagnóstico o de toma de decisiones, pero no debe brindar la recomendación antes de que el profesional o estudiante desarrolle un trabajo cognitivo. Esto preserva el esfuerzo de recuperación de memoria y el punto de desafío óptimo.

- Mitigación del Sesgo mediante Auditorías de Autonomía: La implementación de tecnología debe propender por evitar la dependencia y la pérdida de autonomía. Esto requiere simulaciones periódicas donde el personal resuelve casos complejos sin asistencia tecnológica, garantizando que mantienen la capacidad de operar de forma segura cuando los sistemas fallan. Este modelo es similar al utilizado en el reentrenamiento y certificación de habilidades en pilotos aéreos, donde incluso se desincentiva el uso permanente del piloto automático para evitar que los pilotos no cuenten con las habilidades para responder a retos inesperados.

Figura 3. Propuestas de uso riesgoso y seguro de la IA en el razonamiento clínico

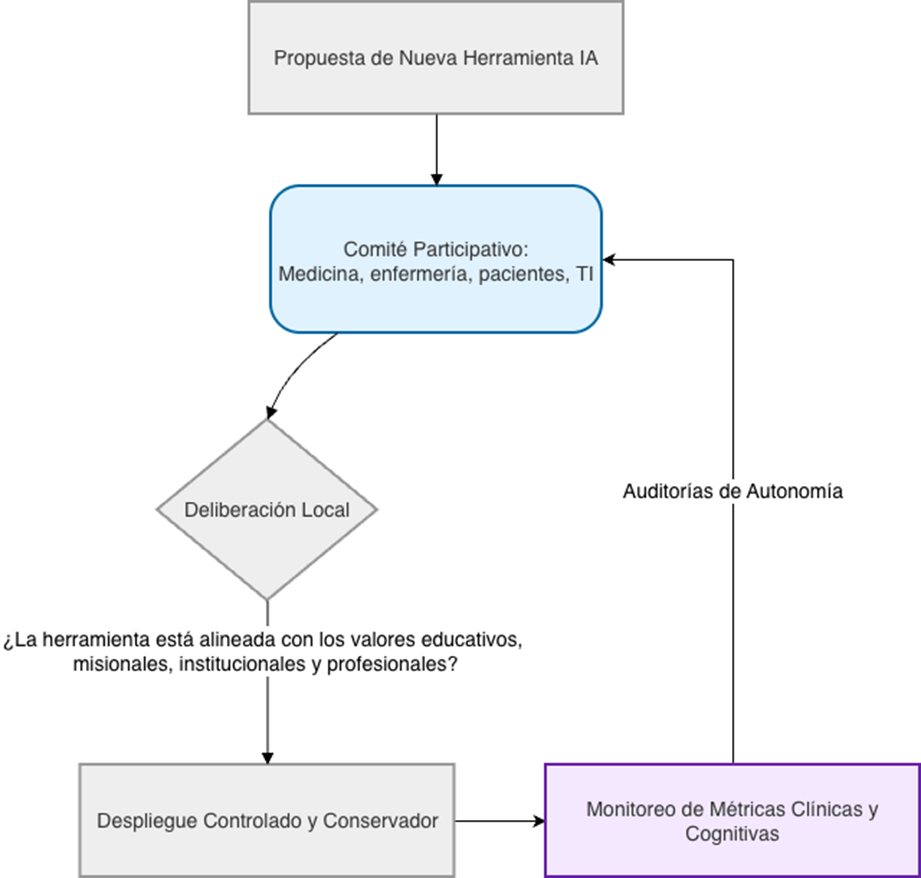

5. Implementación de tecnología guiada en principios éticos

Declarar que un sistema de IA debe ser «transparente y beneficente» ofrece poca guía práctica al director de un programa de residencia. El reto hoy es ayudar al personal en formación a desarrollar marcos cognitivos para seleccionar y reflexionar acerca del uso de modelos de lenguaje y algoritmos comerciales.

Para desarrollar estos marcos de pensamiento es esencial colaborar con profesionales con expertica en filosofía y ética. Un ejemplo de estos modelos de pensamiento fue propuesto por Palmer y Schwan (2024), y se conoce como Conservadurismo Participativo Deliberativo:

- Participativo: La discusión acerca de implementar tecnologías en el ambiente de aprendizaje o la práctica clínica debe incluir a personal médico, de enfermería, científico, administrativo y por supuesto a comunidades de pacientes..

- Deliberativo: Los comités y comunidades locales deben discutir acerca de los valores y misiones institucionales, profesionales que son esenciales para asegurar una excelente atención en salud. Estas comunidades aportaran a la construcción de políticas de implementación de tecnología que respeten esos valores. Estas políticas incluyen el mantenimiento de las habilidades y juicio clínico en profesionales de salud.

- Conservador: Implica establecer y evaluar métricas de buena implementación, basadas en valores. Esas métricas pueden evaluar la evidencia clínica y pedagógica de que la «estructura» formativa del estudiante de pregrado o posgrado, y el especialista, pueda soportar el peso de la tecnología, antes de escalar el uso de una herramienta.

Figura 4. Modelo de Conservadurismo Participativo Deliberativo en la implementacipon de tecnología en salud.

Conclusión

La IA generativa y los modelos de lenguaje, hasta el momento, son los más grandes avances en la meta de generar sistemas artificiales que repliquen algunas características de nuestra forma de comunicarnos y de crear. Sin embargo, delegar nuestro razonamiento en sistemas artificiales, erosiona nuestras capacidades y coloca en riesgo a nuestros pacientes. Al igual que los constructores de buques navales saben que la estabilidad del barco debe preceder al poder de fuego, los educadores en medicina debemos priorizar la adquisición estructurada de competencias a través del esfuerzo y el reto adecuado, en los estudiantes en formación. Nuestro objetivo no es formar médicos que compitan con los computadores en el procesamiento de datos, sino forjar expertos capaces de dirigir, auditar y elevar a la inteligencia artificial para bienestar de las comunidades.

Referencias

- Abdulnour, R. E., et al. (2025). Educational Strategies for Clinical Supervision of Artificial Intelligence Use. NEJM AI. [DOI: 10.1056/NEJMra2503232]

- Bastani, H., et al. (2025). Generative AI without guardrails can harm learning: Evidence from high school mathematics. PNAS. [DOI: 10.1073/pnas.2400000122]

- Bjork, R. A. (1994). Memory and metamemory considerations in the training of human beings. En Metcalfe & Shimamura (Eds.), Metacognition: Knowing about knowing (pp. 185-205). MIT Press.

- Budzyn, P. E., et al. (2025). Endoscopist deskilling risk after exposure to artificial intelligence in colonoscopy: a multicentre, observational study. Lancet Gastroenterology & Hepatology.

- Connell, J. H. (1978). Diversity in Tropical Rain Forests and Coral Reefs. Science, 199(4335), 1302-1310. [DOI: 10.1126/science.199.4335.1302]

- Guadagnoli, M. A., & Lee, T. D. (2004). Challenge point: a framework for conceptualizing the effects of various practice conditions in motor learning. Journal of Motor Behavior, 36(2), 212-224. [DOI: 10.3200/JMBR.36.2.212-224]

- Molli, S. M., & Kurra, R. K. (2026). Hallucination in Large Language Models: A Comprehensive Survey, Taxonomy, and Mitigation Strategies. IJETMS.

- Museo Vasa (Vasamuseet). The History of the Ship. Estocolmo, Suecia.

- Oettl, F. C., et al. (2026). From de-skilling to up-skilling: How artificial intelligence will augment the modern physician. Journal of Experimental Orthopaedics.

- Palmer, A., & Schwan, D. (2024). More Process, Less Principles: The Ethics of Deploying AI and Robotics in Medicine. Cambridge Q. of Healthcare Ethics.

- Qazi, I. A., et al. (2025). Automation Bias in Large Language Model Assisted Diagnostic Reasoning Among AI-Trained Physicians. medRxiv.